脑机接口能否帮助无构音患者重新开口?

大家好,我是康复哥。

今天系统拆解一篇关于无构音患者语音沟通重建的综述文献。

在神经内科、康复科和重症康复的一线场景里,临床上经常会遇到一类非常沉重的患者。他们的语言理解、阅读理解、书写能力,甚至完整的语言系统都还在,但因为口面部运动功能受损,已经无法把想说的话说出来。这样的沟通障碍,常见于肌萎缩侧索硬化症、缺血性脑损伤、脑干病变、脊髓损伤等疾病之后。对这类患者来说,最痛苦的地方往往不只是“不能说”,而是“明明知道自己想说什么,却无法把它表达出来”。

这也是为什么,恢复交流能力,对这类患者的生活质量意义极大。它关系到患者能不能表达需求、维持社交关系、参与家庭决策,也关系到他们能不能保住最基本的尊严和主体性。

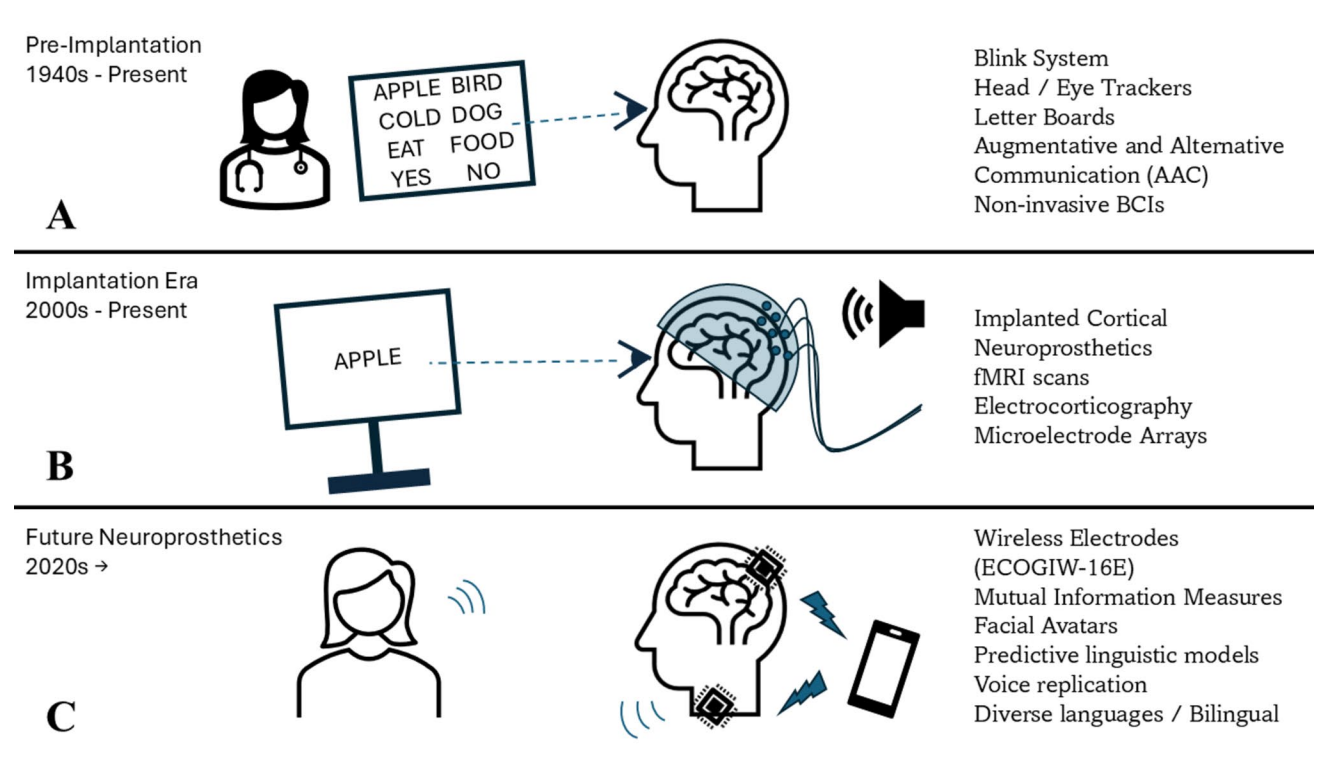

这篇综述的价值,就在于它把无构音患者语音通信设备的发展脉络梳理得非常清楚。从临床视角看,这一演进大致可以分成三个阶段:植入前时代、植入时代,以及未来神经假体时代。

01

植入前时代:在缓慢与局限中维持沟通可能

植入前时代大约始于20世纪中叶,并一直延续到今天。因为直到现在,研究者仍在持续探索怎样在不做手术植入的前提下,尽可能提升患者的沟通效率。

在这一阶段,最早的交流方式非常原始,也非常辛苦。很多患者最开始依赖的是眨眼系统。最简单的是“是”与“否”的二元表达,或者通过约定眨眼次数,在少量选项中作出选择。再往后,一些患者会过渡到字母板交流,通过注视字母、逐个拼写来表达完整意思。

对于仍然保留一定上肢功能的患者,键盘和触摸屏能够提供书面交流的方式。随着触控技术发展,这类方式的交互性比早期字母板更好,但前提仍然很明确:患者得有足够的肢体控制能力。

对瘫痪更重、体力更差的患者,临床上逐渐引入了增强与替代沟通设备,也就是AAC系统。头部追踪、眼动追踪是其中较常见的方案。它们确实让很多患者获得了某种程度上的“可沟通”,但问题同样突出。第一,速度太慢。逐字拼写一句话,远远慢于自然说话。第二,对环境要求高。光照、体位、疲劳状态、眼部条件都会影响使用效果。第三,对重症患者并不总是友好。当病情进一步进展,眼动或头部控制也会逐渐受限。

随着人们对沟通效率要求的提高,非侵入式脑机接口开始被纳入这一领域。脑机接口本质上是一个解码系统,它读取用户的神经活动,再把这些信号转化为某种外部设备可以执行的输出。

在无构音患者交流中,非侵入式脑机接口最早发挥作用的方式,并不是直接“说话”,而是帮助患者更高效地选择、拼写、输出文字。比如眼电图可以记录眼球运动电信号,通过眼周电极把眨眼和眼动解释成选择命令。又比如基于脑电图的拼写系统,可以利用事件相关电位,特别是P300信号,帮助患者在不依赖头部或眼部追踪的情况下完成字母选择。

这一步很重要,因为它在一定程度上摆脱了外部追踪设备对姿势和环境的依赖,也说明大脑信号本身可以作为沟通入口。

同时,语音生成设备也在这一阶段逐步成熟。它们可以把患者通过打字、点击、眼控等方式输入的文字转成合成语音。斯蒂芬·霍金所使用的系统,就是这一类方案的典型代表。它极大改善了交流的互动性,让“文字”重新变成“声音”。

但问题始终没有被真正解决。无论是眼控、头控、脑电拼写,核心逻辑仍然是“拼写”。而拼写这件事,本身就太慢、太费力,也很难接近自然会话。临床上最关键的痛点,其实一直没变:患者想要的是流畅交流,不是艰难地把每一个字母一个一个找出来。

也正因为如此,植入式脑机接口的研究逐渐成为必然方向。

02

植入时代:从拼写交流走向直接语音解码

进入21世纪后,随着电极植入技术和神经解码算法的发展,植入式皮层神经假体成为无构音沟通治疗的重要突破方向。

在早期阶段,植入式脑机接口虽然提升了性能,但并没有立刻摆脱“拼写”模式。一些系统仍然是把植入式信号与字母板、光标点击、打字程序结合起来,帮助患者通过意图控制完成文字输入。

当时已经有研究显示,患者在完全不依赖肌肉动作的情况下,可以通过植入式系统实现较快的打字速度。有研究报道每分钟可正确输入27个字符,也有研究通过将“尝试手写”的神经活动转成文本,使患者达到极高的文字输出效率。和传统眼控、头控相比,这已经是明显进步。

但从沟通本质看,这些系统依然停留在“把话打出来”的层面。它们改善了效率,却还没有真正恢复“说话”本身。正常自然语速通常在每分钟120到150个单词,而任何依赖拼写的交流方式,都很难真正追上这一速度。

真正的转折点,来自语音的直接解码。

神经假体的核心突破在于,它不再要求患者逐字拼写,而是尝试从大脑活动中直接还原单词、短语、句子,甚至合成语音和面部动作。系统记录患者在“尝试说话”时的大脑皮层活动,通过算法把这些信号转换为文本、声音或屏幕输出。换句话说,患者不再是“用脑打字”,而是“用脑说话”。

这类系统之所以被称为神经假体,是因为它并非在训练患者恢复原有通路,而是在构建一条替代性的表达通路。它通过侵入式植入记录皮层活动,用机器解码来接管原本由发声器官完成的输出过程。

早期的技术奠基工作可以追溯到2009年。当时已有研究尝试利用植入电极读取与语音规划相关的皮层活动。虽然那个阶段只能解码元音,还做不到完整单词,但方向已经非常清晰:语音本身是可以从神经活动中被识别出来的。

此后,皮层脑电图成为这一领域的重要路径。它通过将电极放置在大脑皮层表面,记录高时间分辨率的神经活动。研究者先在能够说话的患者身上测试,再逐步扩展到无构音患者。结果显示,系统既可以在大声说话时解码,也可以在无声模仿语音时进行识别。

随着算法优化,准确率持续提高。早期研究在50个单词规模的词汇量下,错误率仍然比较高。但后来通过更复杂的分步解码模型,系统先解码神经活动,再做准确性验证,最后再进行分类,显著提升了性能。有研究在中风后无构音患者中,分类准确率达到87.7%和98.5%。其中,高密度电极布置带来的信号质量提升,是关键因素之一。

更重要的是,这类系统在现实使用中还表现出很高的特异性。研究发现,在加入验证步骤后,系统几乎没有假阳性输出,也就是不会随便“乱说话”。这对于临床应用特别重要。因为沟通设备可以慢一点,但不能总是误发错误信息。

到了2024年,神经假体迎来一个非常关键的里程碑。

此前多数研究仍然依赖提示性任务,也就是让患者看见某个单词,再去尝试说出它。这样做有利于训练和评估,但离真实世界交流还有距离。2024年的突破,在于研究者开始真正测试“自由对话”。

在硬件上,这一研究使用了微电极阵列,电极直接插入脑组织,信号分辨率更高。在算法上,它引入了语言模型,将神经活动先解码成音素,再组合成单词,再进一步组织成句子。这个路径已经非常接近自然语言生成的逻辑。

结果相当惊人。研究在超过22000个句子的规模下,实现了仅2.7%的单词错误率。在自由对话中,超过一半的句子可以被100%正确还原,约三成句子大部分正确,仅有不到15%的句子是不正确的。这已经是迄今为止最接近自然会话场景的临床神经假体之一。

更进一步的是,研究团队还结合了语音生成设备,使用患者在失去言语能力前的声音特征来合成输出。也就是说,系统传达的已经不只是“他说了什么”,还在尽力还原“这句话像是他自己说出来的”。

这一步非常重要。因为对患者而言,交流从来不只是信息传递。声音本身就是身份的一部分。

当然,现阶段植入式技术也有明显局限。最准确、最实时的语音解码,仍然依赖侵入式电极。无论是皮层脑电图还是微电极阵列,都需要手术植入。对许多患者和家庭来说,手术侵入性、长期植入的接受度、经济成本、维护问题、随访条件,都会构成现实门槛。临床上,这仍然是推广过程中绕不开的问题。

03

未来神经假体时代:从“能说话”走向“像人在说话”

未来这一阶段,重点已经不只是让患者“把意思传达出来”,而是让交流更加自然、更加个体化,也更加可及。

第一个方向,是硬件的小型化和无线化。

当前很多高性能神经假体仍然需要通过颅外连接装置和电缆与外部计算机相连,这会带来活动受限、美观不足、护理复杂、感染和瘢痕等问题。无线皮层脑电图阵列的发展,为这一问题提供了新思路。比如可外部充电的无线电极系统,已经在动物实验中证明了记录和刺激皮层的可行性。

如果未来这类设备能真正成熟,患者将不再需要电线穿出颅骨,舒适度、活动能力和长期使用体验都会明显改善。当然,这仍然需要手术植入,只是“植入之后怎么更好地活着用”会得到改善。

第二个方向,是算法升级,尤其是提高非侵入式方案的识别能力。

目前非侵入式系统的核心短板仍然是准确性和速度不够。研究者正在尝试通过更精细的信号分析方法来缩小这一差距。例如,利用互信息测量来分析语音相关脑活动,可以更早识别前额叶和运动前区在发声前的激活模式,也能更敏感地捕捉语音准备和执行中的时空特征。这类方法说明,解码精度的提升,不只靠硬件,也靠对神经信号的理解方式不断更新。

第三个方向,是从“文字和声音”走向“完整交流”。

真实的人类沟通,靠的不只是词句本身,还有语调、节奏、停顿、情绪和面部表情。未来神经假体的发展,很可能要从“能输出内容”进一步走向“能呈现表达风格”。

已经有研究开始尝试构建面部化身系统,通过解码与语音手势相关的神经活动,驱动虚拟化身完成口型、表情和面部运动。这个方向很值得重视。因为对长期失去口面部运动能力的患者来说,面部表达的缺失,往往和言语缺失一样会让人感到“失去自己”。如果未来系统能同时恢复声音和表情,那对沟通质量的提升会是根本性的。

第四个方向,是跨语言能力。

目前语音神经假体的研究主体仍然集中在英语世界,但未来真正走向临床,语言多样性是必须解决的问题。2025年,已经有双语神经假体在英语和西班牙语使用者中完成测试。研究显示,两种语言在语音运动皮层中存在共享神经通路,因此不一定需要为每一种语言都重建一套完全独立的解码基础设施。

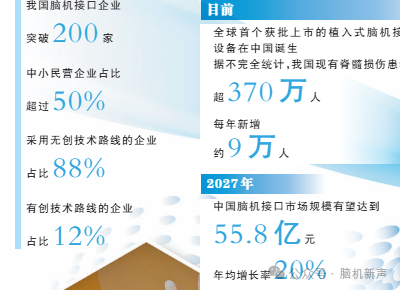

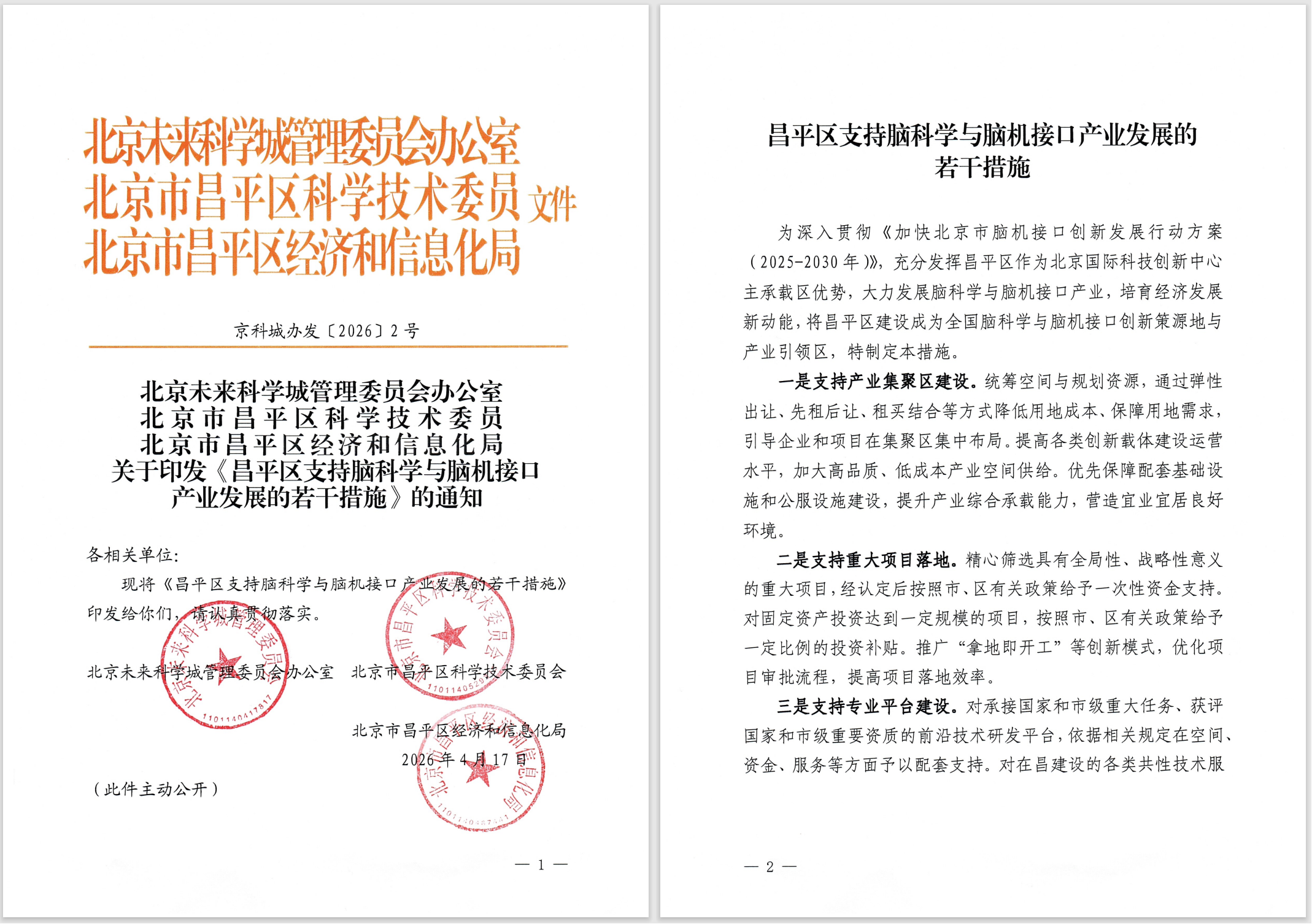

更值得关注的是中文等声调语言。2025年,已有针对普通话的脑机接口系统实现了394个音节的神经解码,准确率达到71.2%。这项工作说明,神经假体并不只适用于拉丁字母语言,也有可能进入汉语语音系统。

这一点对中文临床应用尤其关键。因为未来如果中文语音脑机接口走向临床,它面对的不是简单的词汇映射,而是音节、声调、词义之间更复杂的组合关系。普通话研究的推进,意味着这一领域终于开始往真正的本土临床场景靠近。

第五个方向,是跨场景应用。

神经假体的价值并不限于无构音患者交流。只要核心能力是“读取皮层意图并转成外部输出”,那么它理论上就可以延伸到机器人假肢控制、意识障碍评估、昏迷患者残余意识识别,以及创伤性脑损伤、多发性硬化、脑膜炎后遗症等多种神经系统疾病场景中。

同时,虚拟现实和具身康复也正在进入这一领域。未来的脑机接口,未必只是一个“沟通工具”,也可能成为认知训练、运动康复、社交重建的综合平台。

04

临床启示:技术越往前,越要回到患者本人

读完这篇综述,我觉得最值得临床重视的一点,是我们在讨论前沿技术时,始终要把“患者真正需要什么”摆在中心位置。

神经假体确实代表了无构音患者交流重建最令人振奋的方向。从早期眨眼、字母板,到眼控和脑电拼写,再到植入式语音解码和自由对话,这条路径已经说明一件事:大脑里的“想说话”是可以被技术重新接住的。

但临床决策从来不只是比拼准确率。

对于一部分患者来说,植入手术可能过于侵入,成本过高,收益预期有限,或者与其疾病进展阶段并不匹配。对于这类患者,更成熟、负担更小的AAC系统,仍然可能是更现实的选择。技术先进,不等于对所有人都合适。

还有一个特别重要的人性问题,就是“声音的归属感”。

斯蒂芬·霍金使用合成语音长达30年,最后他已经把那个电子合成音当成了自己的声音。这个例子很有启发。临床上,未来神经假体即使越来越接近自然语音,也不能忽略一个问题:患者自己是否认同这个声音,是否觉得这是“我在说话”。

因为恢复交流能力,最终恢复的不只是句子输出效率,更是一个人和世界重新建立联系的能力。

总的来看,未来神经假体的发展方向已经很清楚。硬件上要更无线、更舒适,软件上要更准确、更智能,语言上要更多元,功能上要从文字和发声走向完整表达。它的终点,不只是帮助患者“能沟通”,而是尽可能让患者重新拥有接近自然、接近自我、接近尊严的交流能力。

对无构音患者来说,这条路还没有走完,但已经不再只是想象。

参考文献:

The evolution of speech communication devices for anarthria: a review. Journal of Neurology, 2026, 273:206.

本文2026-04-03 17:50:42发表“行业新闻”栏目。

本文链接:https://www.yixiuqixie.com/article/1045.html

- 全球非侵入式脑机接口(BCI)行业深度调研与代表性企业进展报告.pdf

- 脑机新声内参:全球脑机接口电极与核心材料技术全景解析.pdf

- 脑机新声内参(下册):中国脑机接口产业扶持与宏观政策汇编.pdf

- 脑机新声汇编《中国脑机接口医疗准入与医保定价全景汇编(上册)》.pdf

- 脑机接口入行指导手册-脑机新声0505(1).pdf

- 河北省脑机接口产业发展规划建议-脑机新声.pdf

- 传统药企进入脑机接口赛道行业研究及可行性分析报告.pdf

- 【压缩版】神经介入企业进入脑机接口赛道的机会和挑战.pdf

- 【脑机新声】全球脑机接口技术前沿:2026年十大最具代表性BCI公司临床进展与行业深度洞察报告.pdf

- 司羿-羿生医用产品总册V2506.pdf