当前我国脑机接口技术的伦理进展与治理应对

来源:脑机之声

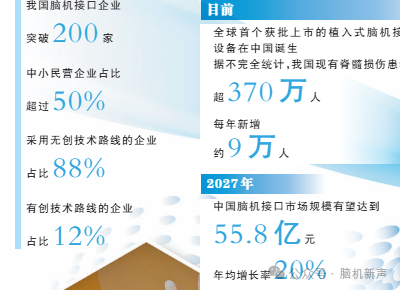

这几年,脑机接口被放在了“未来产业”的C位:一边是渐冻症患者、严重偏瘫患者通过意念重新“说话”“运动”的故事,一边是地方政府、资本、企业在加速布局临床和产业场景。

与此同时,有一条相对安静但非常关键的线索,也在慢慢成形:如何给脑机接口立规矩,特别是伦理上的边界。最近看到一篇发在《中国医学伦理学》的文章《当前我国脑机接口技术的伦理进展与治理应对》,作者系统梳理了国内关于脑机接口伦理的研究,并提出了相应的治理思路,挺值得从产业视角看一眼。

这篇文献主要围绕三大块展开:脑机接口对“行动主体”的冲击,对“认识世界方式”的改变,以及价值层面的风险和期待;在此基础上,提出了从制度、团队到个人的三层治理路径。下面尝试翻译成“产业能听得懂的话”。

一、脑机接口到底在撬动什么底层问题?

谁在“做动作”:行动主体的变化

传统医疗技术更多是“工具”,医生用、患者被用,边界还算清晰。脑机接口开始做的是另一件事:把人的神经系统和机器直接绑在一起,动作是通过意念发出,设备执行。

这样一来,一个很现实的问题就冒出来了:

患者通过植入式脑机接口控制机械臂,如果在公共场所撞到了人、打翻了物品,这个动作算谁的?

是“患者本人”的行为,还是“系统”的故障,还是“设备设计方”的责任?

文献里总结,学界现在的普遍态度是:还不能轻易把脑机接口本身当成一个“道德主体”,但也不能简单当成一把钳子、一块绷带这么朴素的工具。它强化了人的行动能力,却让责任归属变得更加复杂:从算法、硬件、手术,到康复使用和后期调参,链条上每一方都牵得上关系。

对产业来说,这意味着:未来一旦出事,谁也别指望一句“系统出错了”就把责任推干净。

我们怎么“认识世界”:人工认知与“读心”边界

第二个变化,是脑机接口对“认识论”的冲击。

通过脑电、皮层电信号与外部设备交互,脑机接口有可能延展人的感知和认知能力,形成一种带有“技术外挂”的新型认知方式。简单讲,人不再只是通过眼睛看、嘴巴说、手去写,而是有机会直接用脑信号与外界交流。

这听上去非常振奋,但风险点也不难想象:

日常生活里,语言、表情、文字都是经过“筛选”的,是我们有意识地选择给别人看的那一部分自己;

如果脑机接口在未来真的做到“更深层次的信号读取”“多脑互联”,技术层面具备了“读心”的可能,那隐私边界就不是“聊天记录会不会泄露”这么简单,而是“大脑深层状态会不会被人摸透”。

文献中强调,脑机接口带来的“人工认知”不能简单被否定,它确实在拓展人的能力边界。但前提是:要非常清晰地划定信息采集和使用的边界,读脑不等于可以随意读心,技术可行不等于伦理合理。

这件事值不值得做、用在谁身上:价值层面的冲突

在价值层面,讨论更具撕裂感。

一端,是我们熟悉的那种振奋场景:残疾人通过脑机接口参与点燃火炬,偏瘫患者重新用意念写出汉字,严重沟通障碍人群通过脑机设备完成基本表达。这些案例非常直观,社会价值也很好理解。

另一端,则是更隐蔽、但同样现实的担忧:

高密度脑数据的采集、存储和交易,未来可能成为新一轮“隐私泄露”和“数据滥用”的重灾区;

很多目标人群本身存在认知和表达障碍,严格意义上的“充分知情同意”是很难做到的,但在法律和伦理文件里,这又是硬性前提;

一旦增强型脑机接口进入“能力提升”场景,比如学习、竞赛、职业技能,谁能先用、谁用得起,很容易演变成新的不公平与特权来源。

文献的底层判断是:技术本身没有绝对的好与坏,问题往往出在制度安排、资本驱动和人的欲望上。如果这三块不控制好,再好的技术也会被用歪。

二、文章给出的三条治理路线

在分析完目前的伦理争论之后,作者给出了一条相对完整的治理思路,从制度设计、多元团队到个体责任,形成一个“上下勾连”的体系。

制度层面:在鼓励创新和防范风险之间找平衡

第一层,是制度设计。

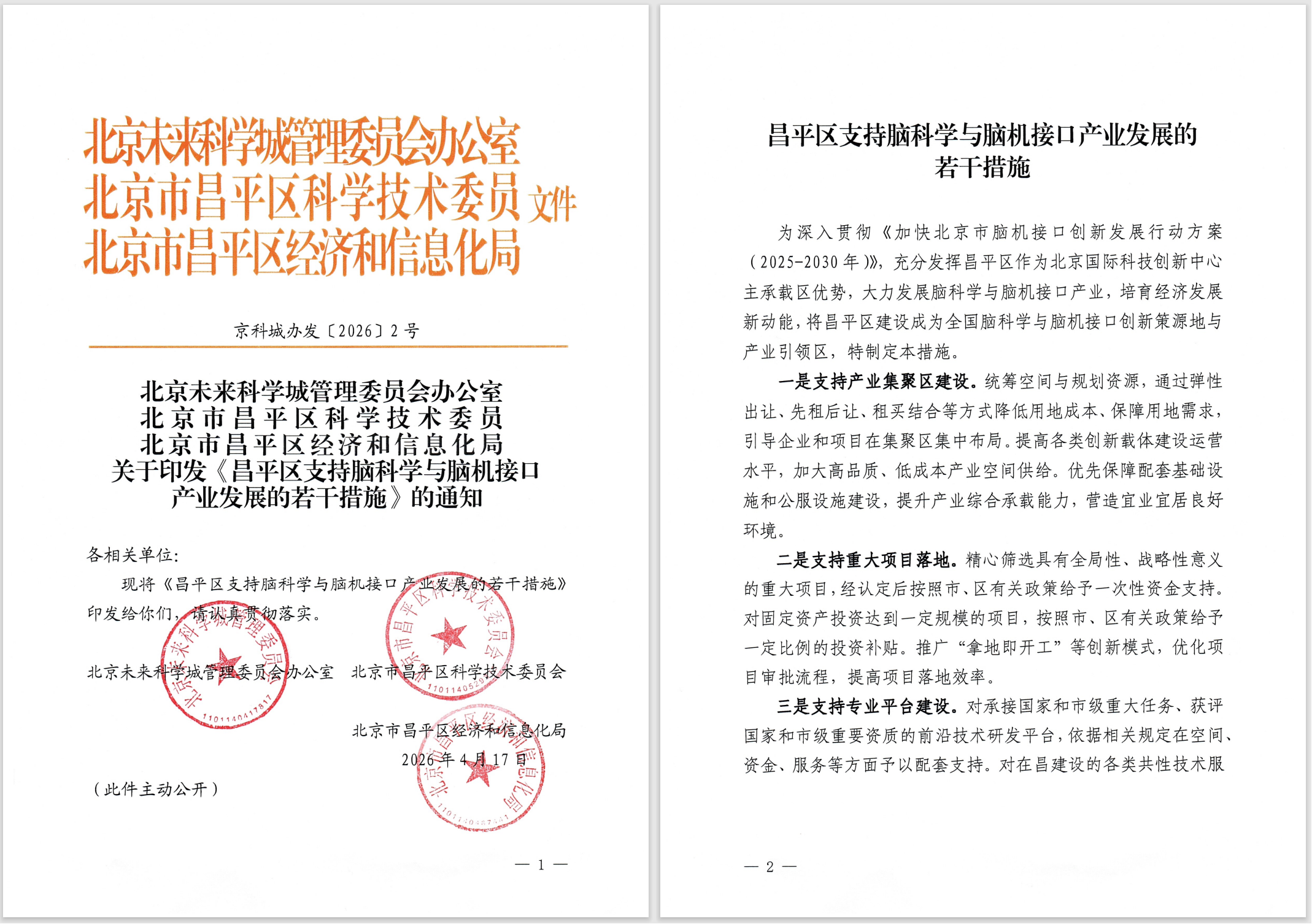

一方面,脑机接口被明确纳入“未来产业”“新质生产力”的重点方向,政策层面需要真正在资金、场景、人才上给予支持,而不是只停留在文件表述上;

另一方面,不能一味只讲“鼓励创新”,该设防火墙的地方必须提前设好,至少包括:

脑数据采集、存储、使用的规则:采什么、不采什么,谁能看、怎么脱敏,必须有清晰的边界;

“控脑”式应用的限制:任何与强制性行为干预、暗示控制相关的场景,都应该被严格限制;

输出信息的审查与溯源机制:当一个动作或决策来自“人+设备+算法”的组合时,要能追踪信号路径,而不是让一切都消失在“黑箱”里。

对监管部门来说,这是一个结构设计问题:既不能一见风险就“一刀切禁止”,也不能只在宣传口径上高调支持,实务层面毫无准备。

团队层面:从“伦理顾问签个字”变成“全过程参与”

第二层,是多元团队的建设。

文献指出,当前不少伦理研究偏重方法和原则,真正落到具体项目上时,缺乏跨学科的细致介入。而脑机接口天生是一个“多学科缠绕”的领域,仅靠个别学科很难兜住所有问题。

更理想的做法是:

在研发、临床试验、示范应用等关键环节,从一开始就把工程师、医生、伦理学者、法律专家、社会学者等拉到同一张桌子上,而不是做完了再请伦理委员“盖章”;

在算法建模、数据标注、场景设计时,尽量避免个别人的偏见被固化在系统里,变成所谓“客观”的选择标准;

在具体项目上,拆清楚每个角色的职责边界,形成一种真正的“互相制衡”,而不是一条龙地把责任压在某个科室、某个项目负责人身上。

对企业和医院来说,这意味着:脑机接口项目不再是“技术+市场”的简单组合,而是必须预留出“伦理成本”“合规成本”,这个成本不只是写几段制度,而是具体要有人、要花时间。

个体层面:不要把所有锅都甩给“技术”

第三层,是回到每一个参与者身上。

文献提醒了一点,经常被忽视:人们在谈论脑机接口时,一方面非常害怕被别人“控制大脑”,另一方面,对自己“控制别人”的欲望往往缺乏足够警惕。类似的矛盾还集中体现在:

要求技术高度透明、公平、无偏见,但日常生活中,人自己做决策时往往很难达到这个标准;

一旦出现意外或事故,总是习惯把责任推给“系统故障”“算法问题”,而不会去正视设计、使用环节中的人祸因素。

所以,技术伦理治理很难完全依靠外部制度和监管,它最终还要落到每一个参与者的自觉:研究者、产品经理、临床医生、监管者、投资方,都需要意识到自己是规则的共同制定者和维护者,而不是规则之外的旁观者。

三、对脑机接口产业的一些现实启示

从“脑机之声”的视角看,这篇文献不是在做抽象哲学体操,而是在悄悄为未来的监管和行业规范画草图。

可以预见的几个方向:

第一,伦理问题早晚会变成“硬约束”。

脑数据治理、适应证边界、增强型应用场景、知情同意模式,这些现在看起来“离业务还挺远”的话题,很可能在不久之后,被写进地方细则、行业指南,成为项目能不能过会、能不能进院、能不能拿到政策支持的关键条件。

第二,企业和医院如果现在就开始“预演”治理,会比别人走得更轻松。

例如:

在产品设计阶段就考虑脑数据最小采集原则、隐私保护方案,而不是等到要备案、要进伦理时临时补一段说明;

在临床合作中,把脑机接口项目纳入医院伦理委员会的常规议程,探索更适合认知障碍人群的知情同意方式;

在对外传播时,少讲“意念控制”的神话,多讲真实风险、多讲治理安排,减少未来舆论反噬的空间。

第三,谁先把“规则思维”做进去,谁就更有资格参与下一轮的行业标准制定。

脑机接口的竞争不会只停留在“谁的算法更准”“谁的硬件更强”,在一个高度敏感、强监管的领域里,谁能更早地把伦理、安全、责任机制融入产品和服务,谁就更容易获得医生、患者和政府的长期信任。

结语

技术的发展往往跑在制度前面,这是常态。脑机接口的特殊之处在于,它直接触碰了“大脑”这一人类最敏感的区域,一旦出现失控事件,带来的不仅是项目的失败,还可能是整个行业的长期信任危机。

这篇关于伦理进展与治理应对的文献,其实在传递一个简单但不轻的话:

脑机接口不会因为担心风险就自动停下脚步,真正决定它走向的是我们怎样设计规则、怎样面对欲望、怎样承担责任。

本文2025-12-13 10:41:43发表“医休观点”栏目。

本文链接:https://www.yixiuqixie.com/article/896.html