聚焦“脑到语音”脑机接口:UC Davis 研究者 Maitreyee Wairagkar 获格鲁伯神经科学国际研究奖

近日,美国加州大学戴维斯分校(UC Davis)神经科学家、神经工程师 Maitreyee Wairagkar 获得 Peter and Patricia Gruber International Research Award in Neuroscience(彼得与帕特里夏·格鲁伯神经科学国际研究奖)。该奖项由 Society for Neuroscience(SfN,神经科学学会)组织评选,得到 Gruber Foundation 支持,面向处于早期职业阶段、在神经科学研究中表现突出的研究人员。

公开信息显示,2025 年该奖项共有三位获得者,Wairagkar 为其中之一;相关披露信息同时提到,获奖者对应奖金为 25,000 美元(具体资助与差旅安排以当年项目规则为准)。

一、这是什么奖项?

“Gruber International Research Award in Neuroscience”是 SfN 奖项体系中的国际研究支持项目之一,设置目的在于支持青年神经科学研究人员开展国际学术交流与合作研究。该奖项通常每年评选少量获奖者(常见为 2–3 名),并在 SfN 年度大会(Neuroscience)相关活动中公布与颁发。

二、她为什么获奖

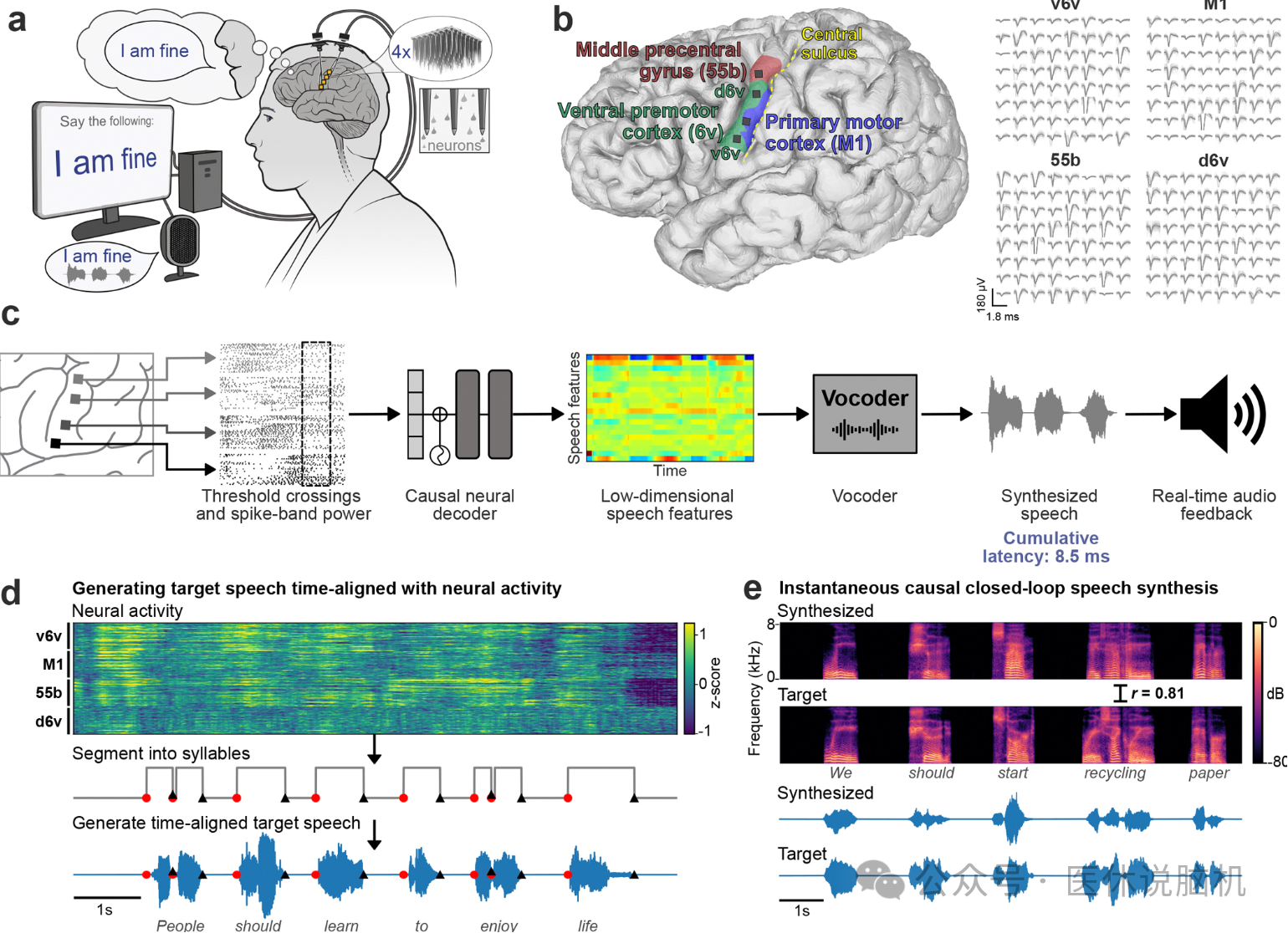

Wairagkar 的获奖工作聚焦于脑机接口(BCI)与神经假体,面向的临床问题主要有两类:一类是神经系统疾病或损伤导致的沟通能力受限(例如严重构音障碍、失语或“锁闭”状态等情境下的表达困难);另一类是运动功能受限(例如上肢运动受限、动作意图难以外显等)。公开信息中被反复提及、并与其代表性成果直接关联的,是“言语神经假体(speech neuroprosthesis)”这一方向,尤其是“脑到语音(brain-to-voice)”路线。

所谓言语神经假体,核心不是“把声音听清楚”,而是在人已经无法通过喉部、口舌、呼吸等外周发声系统完成说话时,直接从大脑活动中读取与“想要说什么、怎么说”相关的信息,再通过计算模型把这些信息转化成可输出的语言结果。与较早期常见的“脑到文字/脑到选择项”不同,“脑到语音”试图把输出形式从离散字符推进到连续语音,让交流更贴近日常对话中的节奏和表达方式。

在公开描述中,这一路线通常涉及一条相对完整的技术链条:前端通过植入式或其他方式记录与言语相关的神经活动;中间对信号进行预处理与特征提取;再由解码模型将神经信号映射为语言单位(例如音素、发音动作参数,或更直接的声学参数);最后由语音合成模块生成可听的音频输出。实际系统还会包含个体化校准与训练流程,使模型逐步适配特定受试者的神经信号特征与使用习惯。

围绕这一方向,公开材料强调的关键技术点可以进一步展开为三部分:

1)直接从大脑信号到语音输出

“脑到语音”的核心在于让输出直接成为语音波形或可立即合成语音的表示形式,而不是先生成文字再用传统 TTS 朗读。这样做的技术含义在于:系统需要能够从神经信号中恢复与“说话动作/发音规划”更接近的连续信息,或者恢复足够丰富的声学信息,使得合成语音在时间上连续、在表达上更自然。与文字输出相比,语音输出更接近真实交流的目标形态,因为实际对话中人并不是“先在脑中打字再朗读”,而是以更连续的方式组织语言与表达。

2)低延迟与实时性

对“能不能对话”来说,延迟是非常硬的指标。低延迟不仅影响交流效率,也决定使用者能否形成稳定的控制感。一个脑到语音系统的总延迟通常由多个环节叠加:神经信号采集窗口长度、信号处理与模型推理时间、语音合成缓冲与播放时间等。公开描述中强调“接近实时”,意味着系统在设计上尽量减少等待和“攒一段再输出”的行为,让输出更像人在对话中即时开口说话,从而支持更自然的轮换发言、插话和即时回应。更重要的是,实时性为后面的闭环反馈提供基础,没有足够快的反馈,使用者很难根据输出结果即时调整自己的控制策略。

3)语调与韵律等副语言信息(prosody)

在真实交流中,“说什么”只是内容层面,“怎么说”同样关键。语调、重音、语速、停顿、音高变化、强弱变化等韵律特征,承载了大量语义与交互信息,例如疑问句与陈述句的区别、强调重点、表达情绪、表达礼貌或紧迫感等。公开信息提到的“可调制语调/音高”等能力,本质上是在解码目标里加入了这些副语言维度,使系统输出不只是“可懂的声音”,还更接近“可交流的说话方式”。在工程实现上,这通常意味着解码端需要能够输出或控制与音高(如基频变化)、时长(节奏与停顿)、能量(强弱)等相关的参数,并在语音合成端把这些参数稳定地反映到最终声音里。

综上,这一获奖工作所突出之处在于:它将脑机接口在沟通辅助场景中的输出形态进一步推进到“语音层”,同时围绕实时性与韵律表达这两个决定“能否像对话一样交流”的关键要素,建立更完整的系统路径。

三、代表性研究进展

公开论文信息显示,其团队在 Nature 期刊发表了与“即时语音合成神经假体”相关的研究工作。该研究在一名 ALS(肌萎缩侧索硬化)受试者中采用 植入式(intracortical)信号采集,并披露使用规模为 256 个微电极的采集阵列记录皮层活动。

研究的公开摘要与介绍材料显示,这套系统的输出目标为 即时合成语音,并包含 闭环听觉反馈(即受试者能够听到系统输出,从而在使用过程中进行调整)。同时,研究提及对部分“副语言特征”的解码与表达能力,使受试者能够在合成语音中体现语调变化,并展示了对简短旋律输出的能力。

四、研究者与机构背景:神经工程与人工智能交叉路径

公开信息显示,Wairagkar 目前在 UC Davis 从事研究工作。其研究路径属于典型的 神经科学 × 工程 × 人工智能交叉方向:以神经信号采集为基础,结合机器学习/解码模型与人机交互系统,围绕临床人群的功能恢复与辅助沟通开展研究与系统开发。校方公开介绍亦提及,她在加入 UC Davis 之前曾在英国高校与研究机构开展相关研究工作,研究主题覆盖植入式与非侵入式脑机接口、人机交互与康复相关应用等方向。

本文2025-12-14 17:17:13发表“行业新闻”栏目。

本文链接:https://www.yixiuqixie.com/article/904.html